Van, amelyik még a közhivatalok legmagasabb szintjéig is eljut.

A német közszolgálati televízió, a ZDF február végén visszahívott egy amerikai tudósítót, miután egy mesterséges intelligencia által generált klip jelent meg az amerikai bevándorlási és vámhatósági ügynökökről (ICE) szóló riportban.

HIRDETÉS

HIRDETÉS

HIRDETÉS

HIRDETÉS

A műsorszolgáltató bocsánatot kért a klip felhasználásáért, amely az ICE ügynökei által letartóztatott anyjukba kapaszkodó gyermekeket ábrázolta. A videón Sora vízjel szerepelt, ami egyértelműen jelzi, hogy az OpenAI videóeszközével készült.

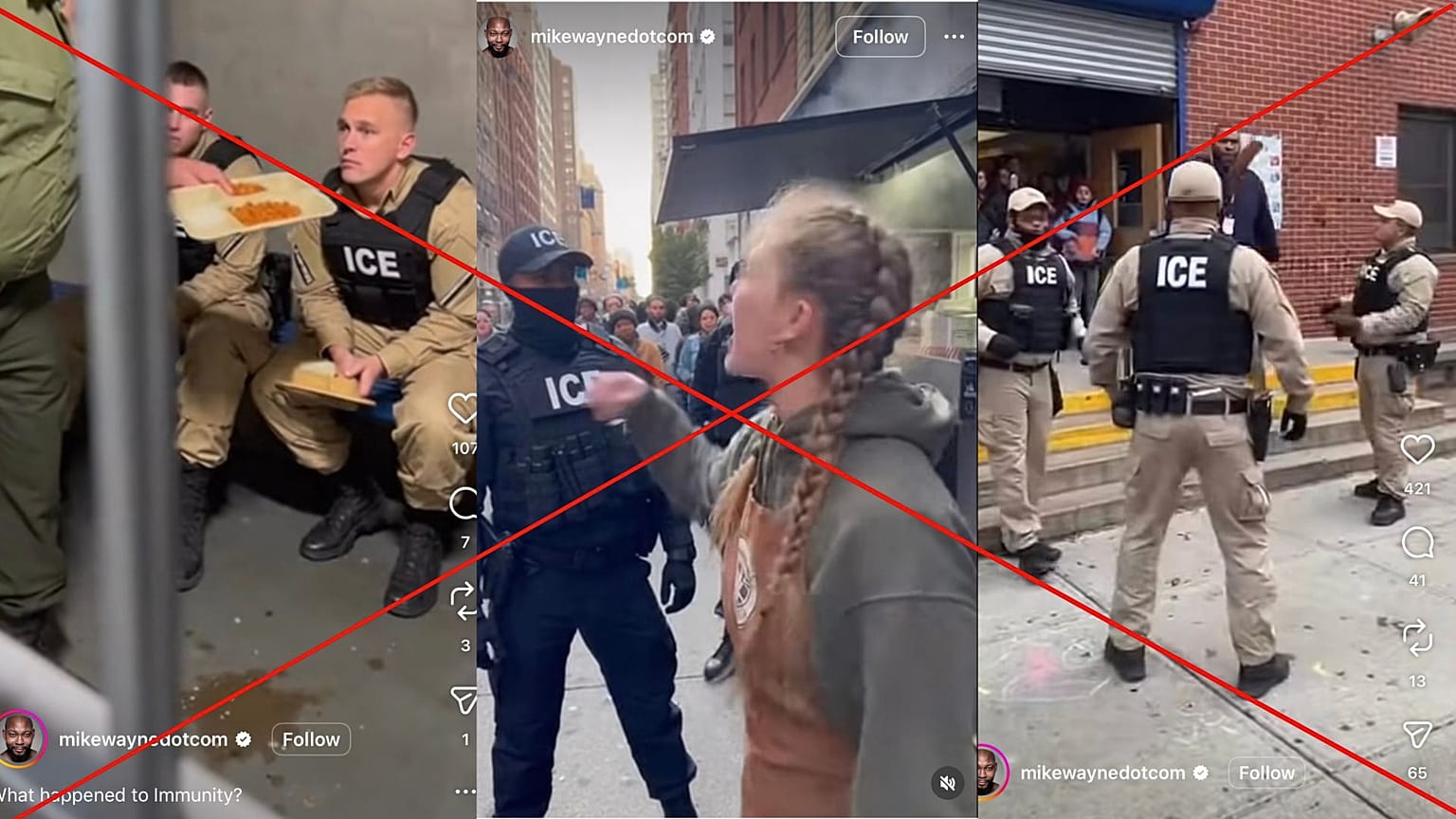

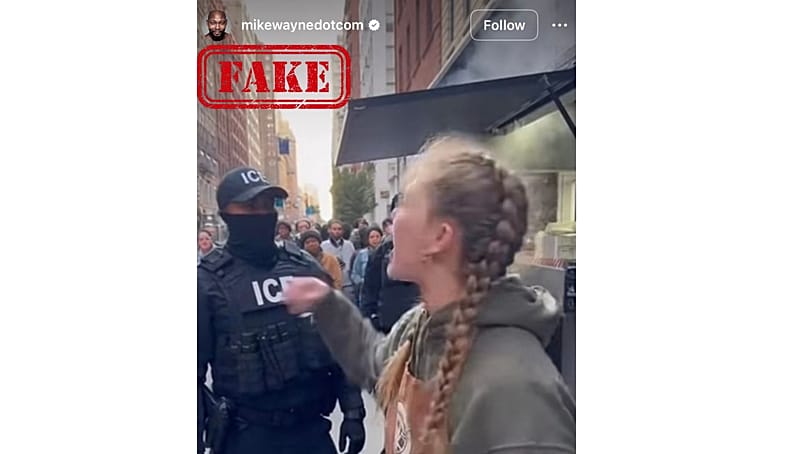

A The Cube, az Euronews tényellenőrző csoportja megállapította, hogy a videó egyike az ICE-ügynökökről készült, mesterséges intelligencia által generált klipek ezreinek, amelyek elárasztják a közösségi médiát, sok esetben egyértelmű jelölés nélkül, és együttesen több millió megtekintést gyűjtenek.

Egységes minta

A TruthScan nevű, mesterséges intelligenciát észlelő cég által a The Cube-nak átadott adatok több mint 200 rövid klipet mutatnak, amelyekben ICE-ügynököket ábrázolnak, akiket tanárok üldöznek, akik bárokban verekednek, és akiket a New York-i rendőrség (NYPD) tartóztat le a metróban.

A TruthScan elmondta, hogy több mint 200 videót kapart össze egyetlen Instagram-fiókból. A videók rövidek, drámaiak és érzelmekkel teliek.

A The Cube megállapította, hogy a fiók még mindig tömegesen posztol mesterséges intelligencia által generált klipeket az ICE-ről, némelyik több ezer, mások több millió megtekintést érnek el.

Számos jel utal arra, hogy a videók nem valódiak: az egyik példában egy ICE-ügynök és egy kávézó dolgozója közötti konfrontáció során gőz látszik felszállni egy szilárd felületen keresztül - ez egy finom jel arra, hogy a klip szintetikus.

A TruthScan szerint mindegyik videó vagy pontosan 10 vagy 15 másodperc hosszú volt, ami erősen arra utal, hogy az OpenAI Sora 2 videomodelljével generálták őket, amely 10 vagy 15 másodperces videókat kínál a felhasználóknak.

Ellentétben sok AI által generált videóval, amelyek vízjelet tartalmaznak, ezeknek az ICE-klipeknek a többsége nem tartalmaz vízjelet.

Hasonlóképpen, tavaly novemberben a 404 Media arról számolt be, hogy az ICE-ügynökökről készült, mesterséges intelligenciával generált klipek egy Facebook-fiókról terjedtek el, és csak az egyiket 4 millióan nézték meg. A videókat azóta eltávolították.

A közbizalom szélesebb körű veszélyeztetése

Szakértők szerint a kockázat az egyes klipek téves címkézésén túlmenően a kényes politikai kérdésekkel kapcsolatos hamis tartalmak szélesebb körű elterjedésére is kiterjed, ami alááshatja a közbizalmat.

"Jelentős kockázatot jelentenek a bűnüldöző szervek intézkedéseire adott kollektív reakciók, mind negatív, mind pozitív értelemben" - mondta Ari Abelson, az OpenOrigins nevű, a mélyhamisítványokat felderítő médiahitelességgel foglalkozó vállalat társalapítója.

"Ez aggodalomra ad okot a bűnüldöző szervek számára, akik szeretnék fenntartani a bizalmat, de fontos az intézmények számára is, amelyek felelősségre vonják őket, ha túllépik a határt" - mondta Abelson a The Cube-nak.

A ZDF adásához hasonlóan az AI által generált ICE-tartalmak nem korlátozódnak az anonim fiókokra. Néha még a közhivatalok legmagasabb szintjéig is eljut.

Januárban a Fehér Ház egy digitálisan módosított képet tett közzé Nekima Levy Armstrong aktivistáról és ügyvédről, miután letartóztatták egy ICE-vel kapcsolatos minnesotai tüntetésen.

Egy elemzés szerint a módosított képen Armstrong az eredeti képhez képest sötétebb bőrűnek és láthatóan zokogónak látszik.

A Fehér Ház a kép manipulációjával kapcsolatos kérdésekre Kaelan Dorr kommunikációs igazgatóhelyettes posztjával válaszolt, amelyben ez állt: "Ismétlem, azoknak az embereknek, akik szükségét érzik, hogy reflexszerűen védelmezzék az országunkban elkövetett szörnyű bűncselekmények elkövetőit, megosztom veletek ezt az üzenetet: A törvény végrehajtása folytatódni fog. A mémek folytatódni fognak."

Armston azt mondta, hogy "undorodik" a Fehér Ház miatt, amiért közzétette a képet.

Abelson szerint az aggodalom akkor merül fel, ha nincsenek olyan védőkorlátok - vagy biztosítékok -, amelyek egyértelműen jelzik, hogy a tartalom hamisítvány.

"Politikai karikatúrákat mindig is használtak a politikában, és ezeket is nagyon hasonló módon használják" - mondta. "A legfontosabb különbség az, hogy a videók mennyire hiperrealisztikusak".

"A közösségi és információs tereknek egy dologra van szükségük: arra, hogy bizonyítani lehessen, hogy egy fotó vagy videó valódi, így a hamisítványokat fikcióként élvezhetjük, és átélhetjük a valós események súlyosságát" - tette hozzá.